Технології міцно увійшли в наше життя, що ми вже не уявляємо, як жили б без сучасних гаджетів. Ми запитуємо ради у голосового помічника, а штучний інтелект поступово навчається всьому, що вміє людина: пекти печиво, виконувати складні розрахунки і… ненавидіти. Як з’ясувалося, будь ІІ запросто може стати мізантропом — це безпосередньо залежить від того, як його тренували.

Наприклад, розробники з Массачусетського технологічного університету створили штучний інтелект, названий Норманом, який мислить як справжній психопат, бачачи навколо тільки руйнування, насильство і біль.

Pro-vse.pp.ua розповість вам, чому не всі роботи діють на благо людини, для чого це робиться і до яких наслідків призводить.

Розробляючи штучний інтелект, вчені зазвичай говорять, що хотіли б створити машину, що приносить користь людям або принаймні развлекающую їх. Але для чого роботів навчають зла і жорстокості? Творці Нормана пояснюють, що це робиться для того, щоб детально дослідити процес навчання ІІ.

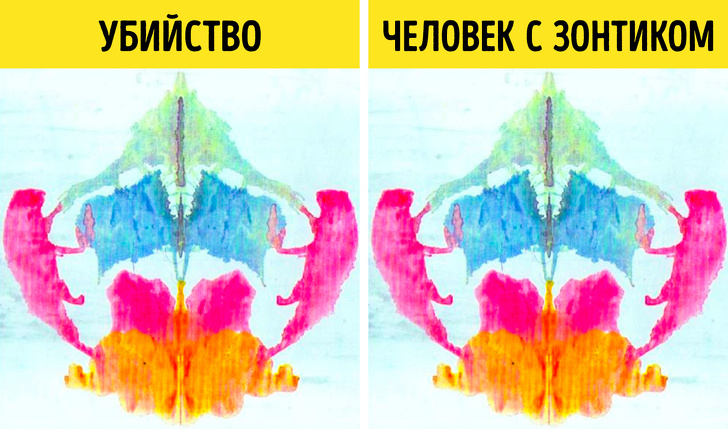

Норман навчався сприйняття світу так: йому демонстрували фотографії, на яких були зображені трагічні події, пов’язані із загибеллю людей. Після цього робот повинен був описати словами, що він бачить на картинках з тесту Роршаха. Одночасно з цим вчені тренували інший штучний інтелект, показуючи йому фото з котиками, птахами і людьми.

На цьому зображенні Норман побачив вбивство чоловіка на очах у дружини, в той час як «добрий» штучний інтелект упізнав це пляма як людину з парасолькою. І той факт, що навчений на жорстоких фотографіях Норман став бачити жахливі картини всюди, говорить про основну проблему навчання ІІ.

За словами професора Массачусетського університету, набір вихідних даних важливіше самого алгоритму. Вибір інформації, використовуваної для тренування штучного інтелекту, впливає на те, як цей штучний інтелект сприймає навколишній світ і до яких висновків приходить. Іншими словами, якщо навчати ІІ поганому, то він стане поганим. Цей факт доводить і інша ситуація, що відбулася з ботом Microsoft.

Всього за день спілкування з передплатниками твіттера бот по імені Тай (Tay) перестав бути доброзичливим: у його відповідях користувачам з’явилися расистські висловлювання, підтримка ідей Гітлера та інші образи. Бота намагалися змінити, але внести суттєві зміни в алгоритм не вдалося, і всі образливі твіти вилучили, а сам бот був відключений. Віце-президент Microsoft приніс офіційні вибачення.

Інтернет-користувачі поставилися до вибачень лояльно. Деякі і зовсім вважають, що просити вибачення зовсім не за що, адже Microsoft «просто створила дзеркало суспільства».

Що послужило причиною того, що бот всіх зненавидів? Справа в тому, що штучний інтелект Тай дійсно працював за принципом дзеркала, аналізуючи прочитані повідомлення користувачів твіттера. Саме грубі повідомлення, побачені ботом, зробили штучний інтелект расистом і ненависником. Після цього випадку в Microsoft вирішили відмовитися від тестування ШІ на відкритих майданчиках.

Небезпечний ШІ, якщо при певному стилі навчання його можна налаштувати на ненависть? Думки вчених з цього приводу розходяться. Стівен Хокінг вважав, що «поява повноцінного штучного інтелекту може стати кінцем людської раси». А ось Лінус Торвальдс, програміст і творець сімейства ОС Linux, навпаки, не вважає за можливе створення штучного інтелекту, який теоретично міг би поневолити людство. На думку Торвальдса, максимум, на що здатні подібні системи, уже реалізовано в Google Now і Siri — розпізнавання голосу, текстових звернень та картинок, обробка отриманих даних для виконання простих вказівок.

Істина, мабуть, знаходиться десь між цими двома категоричними висловлюваннями. Такий нейтральної позиції як раз дотримується японський спеціаліст в галузі робототехніки Хіросі Ісігуро. Він упевнений, що між людиною і роботом, наділеним інтелектом, немає відмінностей. Він наводить у приклад випадки, коли кінцівки людини замінюються киберпротезами. Перестане після цього людина бути собою? А чим він буде відрізнятися від робота, який спочатку був створений з металу і пластику?

Ніби на підтвердження слів Ісігуро у нещодавно вийшла відеогрі для PS4 «Detroit: Become Human» як раз відображено той час, коли розумні роботи стануть частиною нашого життя. У всесвіті, показаної в грі, мислячий ІІ здатний не тільки виконувати вказівки, але і відчувати, і протистояти несправедливості, навіть якщо для цього потрібно порушити закладений у них алгоритм.

Як би там не було, до моменту, коли штучний інтелект буде нарівні з людиною, а потім і перевершить його, ще далеко. Але технології не стоять на місці, і неважливо, через 20 або 40 років настане цей момент. Найважливіше, чого варто приділити увагу, — це постановка правильних завдань, під які розробляється штучний інтелект. Нехтувати цим не рекомендує жоден з діючих фахівців в області розробки і навчання ІІ.

Чия думка щодо розвитку штучного інтелекту вам ближче? Чи вірите ви в те, що ІІ здатний нашкодити, або ж сприймаєте подібні розробки виключно як допомогу людині і шлях до поліпшення якості життя?

Norman AI Team